¿Alguna vez has oído hablar de robots asesinos? Aunque suene a ciencia ficción, la realidad es que ya están entre nosotros bajo el nombre técnico de armas autónomas letales.

Estamos al borde de una nueva era en la guerra y la seguridad global. En este artículo, exploraremos qué son estas armas, ejemplos históricos, y la línea ética y legal que están cruzando. Prepárate para sumergirte en un tema tan fascinante como preocupante.

Si prefieres consumir este contenido en formato de vídeo, ¡dale un vistazo a continuación!

¿Qué son las Armas Autónomas Letales?

La ONU define un arma autónoma letal como aquella capaz de localizar, seleccionar y atacar objetivos humanos sin intervención humana.

A lo largo de la historia, hemos visto armas con algunas de estas capacidades. Las minas terrestres, por ejemplo, pueden atacar un objetivo bajo ciertos criterios, pero no pueden localizarlo por sí mismas. Los misiles guiados, por otro lado, requieren ser dirigidos por humanos. Pero, ¿qué pasa cuando las armas cruzan la línea hacia la total autonomía?

La Evolución hacia la Autonomía Total

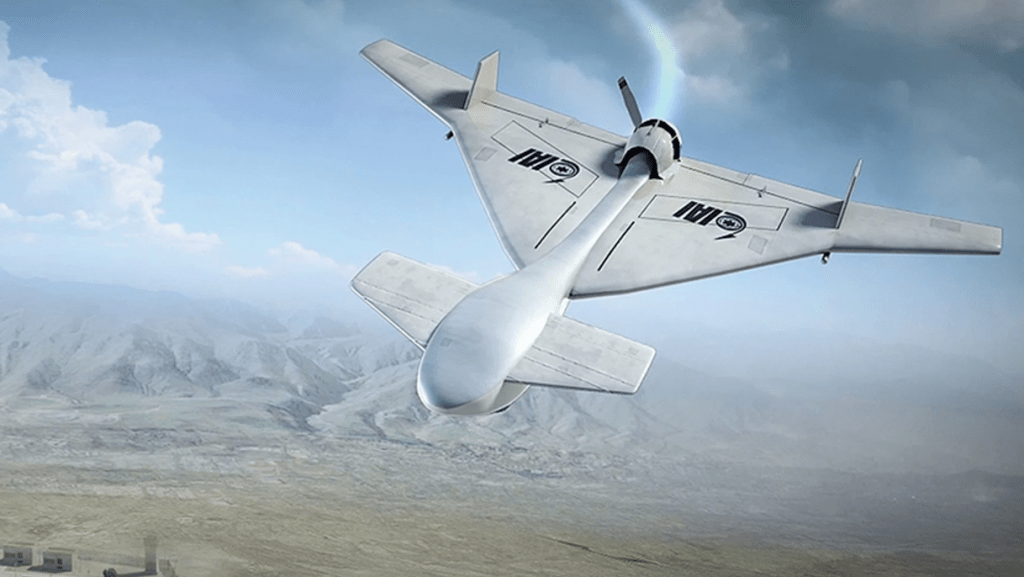

Israel y Turquía están a la vanguardia en este campo. El misil Harop de Israel puede buscar objetivos durante horas en áreas específicas, mientras que el quadcopter Kargu de Turquía puede ejecutar ataques autónomos. Además, el uso de drones de IA en conflictos como la guerra de Ucrania marca un hito en la implementación de estas tecnologías.

La Tercera Revolución en la Guerra

Se considera a las armas autónomas como la ‘tercera revolución en la guerra’, tras la pólvora y las armas nucleares. Su atractivo radica en ser potencialmente más baratas, rápidas, maniobrables y con mayor alcance que las armas tripuladas. Sin embargo, esto nos lleva a una encrucijada ética y legal significativa.

El Debate Internacional y la Legalidad

Desde 2014, la ONU ha debatido sobre la prohibición de estas armas. Algunos países abogan por un tratado para prohibirlas, mientras que otros, como Estados Unidos e Israel, se oponen. El desafío técnico y ético radica en que estas armas deben poder discriminar entre combatientes y civiles, un requerimiento esencial en la ley internacional.

Ética y Moralidad en la Guerra Autónoma

La pregunta ética fundamental es: ¿deberíamos permitir que una máquina tome decisiones sobre la vida y la muerte?

Alemania y numerosas ONGs se oponen firmemente a esta idea.

Sin embargo, hay argumentos a favor, como la precisión y la reducción de bajas civiles. Pero estos beneficios vienen acompañados de riesgos como el hackeo, malfunciones y daños no previstos, lo que plantea el temor de que estas armas se conviertan en instrumentos de destrucción masiva.

El Futuro: Entre el Control y la Carrera Armamentista

Nos encontramos en un punto de inflexión crucial.

¿Deberíamos abrazar esta tecnología y arriesgarnos a una nueva forma de guerra, o centrarnos en crear leyes y acuerdos internacionales para protegernos?

La postura de países clave como Estados Unidos e Israel añade complejidad a este debate global.

Conclusión: Una Reflexión Necesaria

Este tema, sin duda complejo y delicado, no ofrece respuestas fáciles. Mi opinión personal es que una IA no debería tener el poder de decidir sobre la vida humana, un poder que, en realidad, nadie debería poseer.

A pesar de vivir en la época más pacífica de la historia, las guerras continúan, y el avance de estas tecnologías solo incrementará su uso en conflictos futuros si no se establece una prohibición global.

¿Quieres Saber Más?

Si este tema te ha interesado y deseas explorar más sobre el la inteligencia artificial te puedes inscribir en nuestro curso de Inteligencia Artificial para todos.

Fundador de Datademia y formador especializado en análisis de datos, ciencia de datos, ingeniería de datos y negocios.

Ayudo a profesionales a adquirir habilidades prácticas a través de formaciones online en Datademia para impulsar sus carreras. Conecta conmigo en LinkedIn.